浏览器端本地运行语言模型 = Transformers.js + WebGPU + Phi-3

介绍

Phi-3-mini-4k-instruction,这是一个38.2亿的参数LLM,它针对Web上的推理进行了优化。下载后,模型(2.3 GB)将被缓存,并在您重新访问页面时重用。

所有内容都直接在浏览器中运行,这意味着您的对话不会发送到服务器。🤗甚至可以在模型加载后断开与互联网的连接!

使用步骤

进入网址:点击进入

点击: load model, 大约也就2个G多一点,下载完成后就可以正常使用啦。

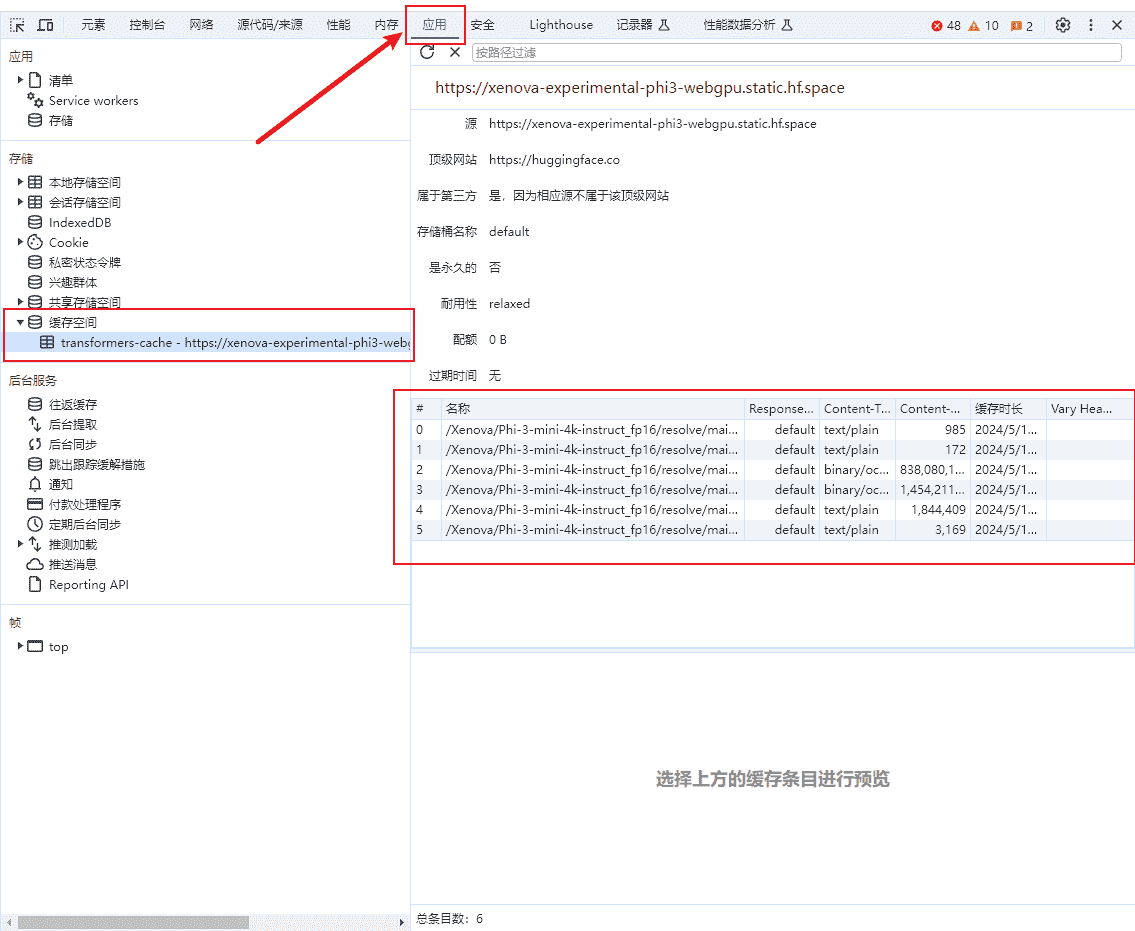

大模型被缓存到浏览器里(按F12查看)

相关链接

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来自 罗布斯!

评论

TwikooGitalk